如何正确设置robots.txt文件

更新时间:2019-04-30 作者:百搜科技一、什么是robots.txt文件

Robots是网站与spider沟通的重要渠道,也可以说是网站和搜索引擎的一个协议,站点通过robots文件告诉spider本网站中不想被搜索引擎收录的部分或者指定搜索引擎只收录特定的部分。

从搜索引擎优化的角度来看,可以通过屏蔽页面,达到集中权重的作用,这也是SEO中robots.txt文件的重要性。

二、网站为什么设置robots.txt文件

1、设置访问权限保护网站安全,例如限制访问后台数据文件

2、禁止搜索引擎爬取无效页面,集中权值到主要页面。例如:联系我们,声明,关于我们

三、如何正确设置robots.txt文件

User-agent:用于描述搜索引擎robot的名字。在“robots.txt”文件中,如果有多条User-agent记录说明有多个robot会受到“robots.txt”的限制。

对该文件来说,至少要有一条User-agent记录。如果该项的值设为*,则对任何robot均有效,在“robots.txt”文件中,“User-agent:*”这样的记录只能有一条。

如果在“robots.txt”文件中,加入“User-agent:SomeBot”和若干Disallow、Allow行,那么名为“SomeBot”只受到“User-agent:SomeBot”后面的Disallow和Allow行的限制。

Disallow:该项的值用于描述不希望被访问的一组URL,这个值可以是一条完整的路径,也可以是路径的非空前缀,以Disallow项的值开头的URL不会被robot访问。

例如“Disallow:/help”禁止robot访问/help.html、/helpabc.html、/help/index.html,而“Disallow:/help/”则允许robot访问/help.html、/helpabc.html,不能访问/help/index.html。

在“/robots.txt”文件中,至少要有一条Disallow记录。如果“/robots.txt”不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。

例如“Disallow:/help”禁止robot访问/help.html、/helpabc.html、/help/index.html,而“Disallow:/help/”则允许robot访问/help.html、/helpabc.html,不能访问/help/index.html。

在“/robots.txt”文件中,至少要有一条Disallow记录。如果“/robots.txt”不存在或者为空文件,则对于所有的搜索引擎robot,该网站都是开放的。

Allow:用于描述希望被访问的一组URL,与Disallow项相似,这个值可以是一条完整的路径,也可以是路径的前缀,以Allow项的值开头的URL是允许robot访问的。

例如“Allow:/hibaidu”允许robot访问/hibaidu.htm、/hibaiducom.html、/hibaidu/com.html。一个网站的所有URL默认是Allow的,所以Allow通常与Disallow搭配使用,实现允许访问一部分网页同时禁止访问其它所有URL的功能。

例如“Allow:/hibaidu”允许robot访问/hibaidu.htm、/hibaiducom.html、/hibaidu/com.html。一个网站的所有URL默认是Allow的,所以Allow通常与Disallow搭配使用,实现允许访问一部分网页同时禁止访问其它所有URL的功能。

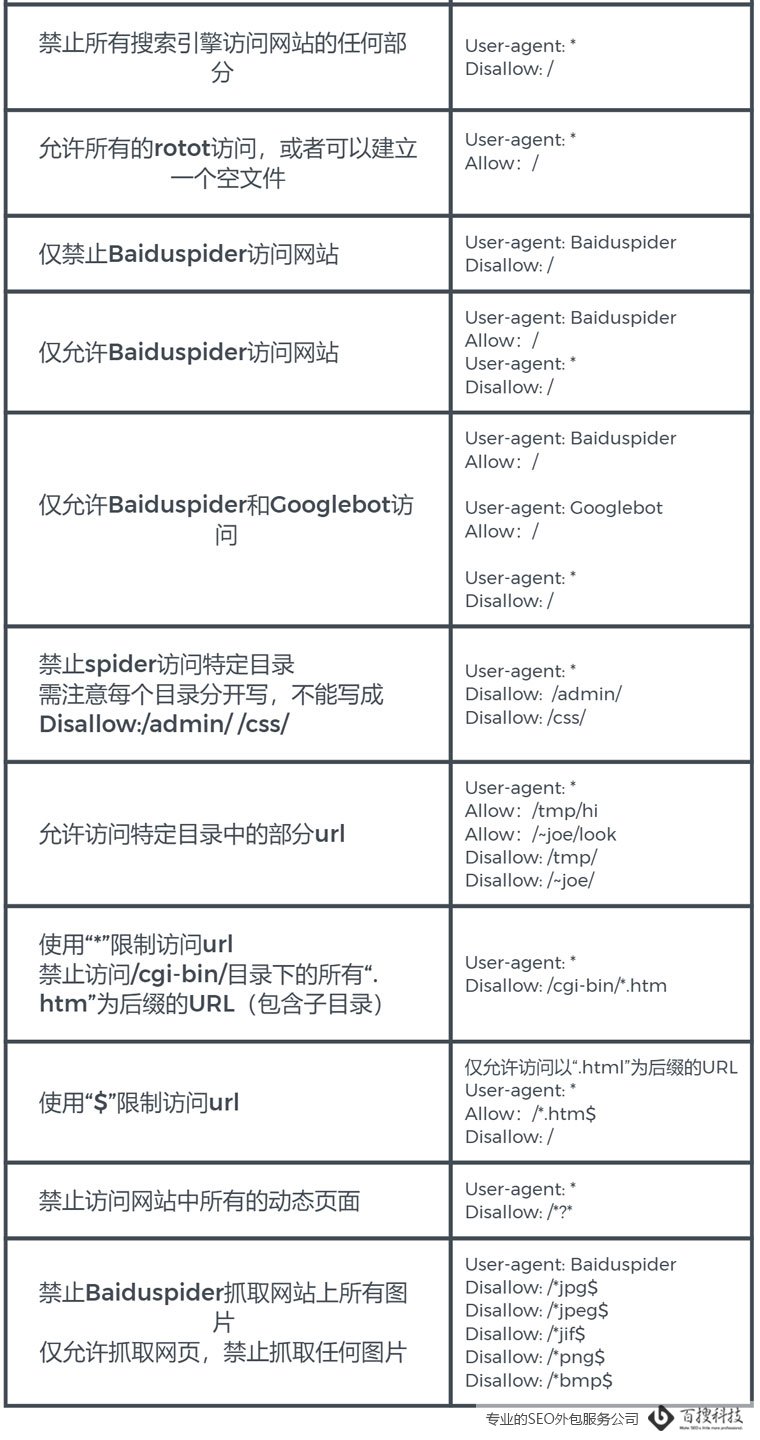

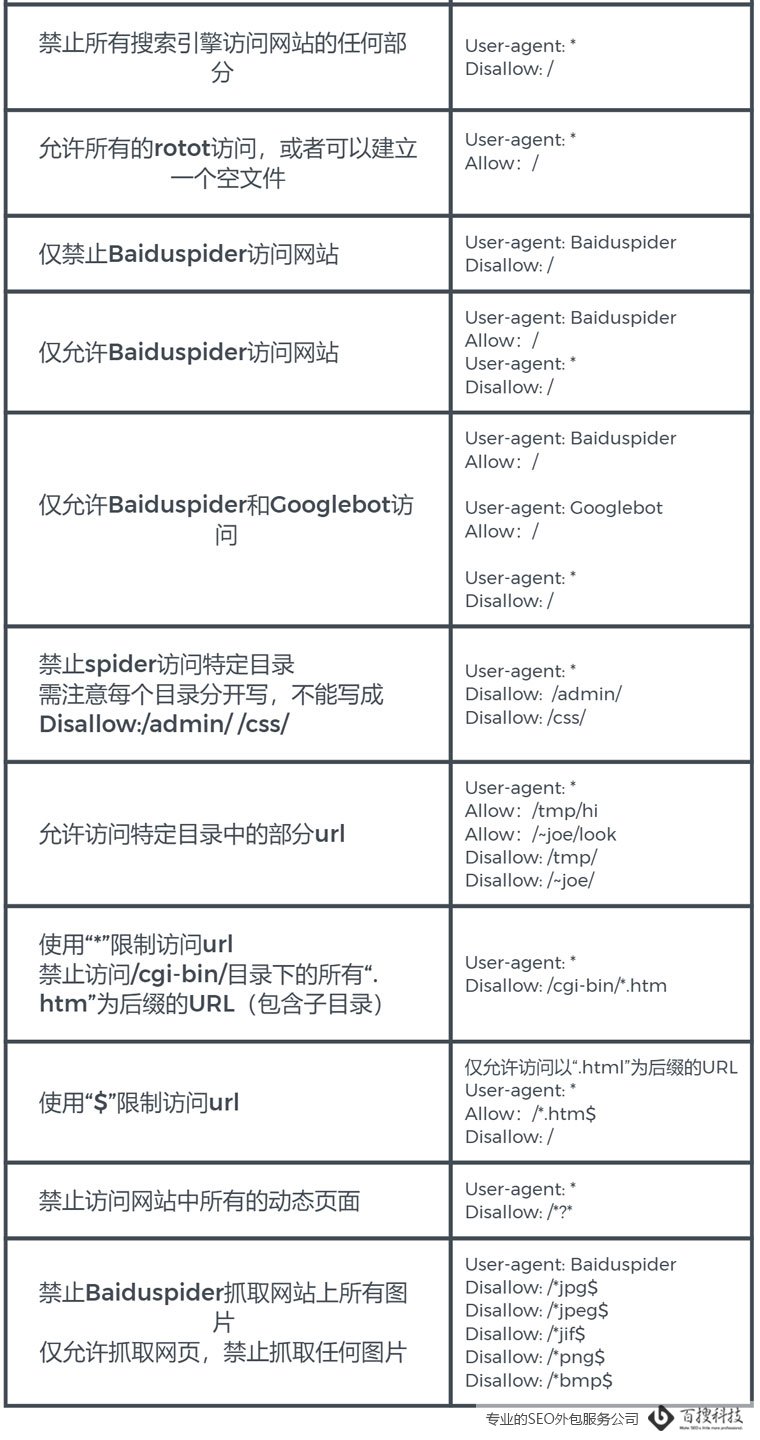

四、robots.txt文件用法举例

% 的用户阅读了以下内容